Kiezen voor schaalbare AI-techniek met data-ethiek

(Jack Vos van Onesurance en Max Roeters van Brush-AI.nl in VVP 1, 2023) We zien het elke dag op kantoor, door moderne computertechnologie groeit de berg ‘big data’ exponentieel. Maar wat kunnen we met deze, nog nietszeggende, data? Hoe maken we er bruikbare informatie van, die ons figuurlijk in formatie zet waardoor we betere beslissingen nemen en klantbediening kunnen verbeteren? En hoe zorgen we ervoor dat deze data gedreven besluitvorming op een ethische en verantwoorde manier gebeurt?

Wijsheid is de kunst om in alle omstandigheden juist te oordelen en te handelen. Eén ding staat daarbij wel vast: cycli van steeds nieuwere technologieën met meer en meer beschikbare informatie, verwart ons eerder dan dat het bijdraagt aan kennis en wijsheid. Dit constateerde schrijver T.S. Eliot al in 1934. In een inspirerende poëem schrijft hij:

Where is the Life we have lost in living?

Where is the wisdom we have lost in knowledge?

Where is the knowledge we have lost in information?

The cycles of heaven in twenty centuries

Brings us further from God and nearer to the Dust.

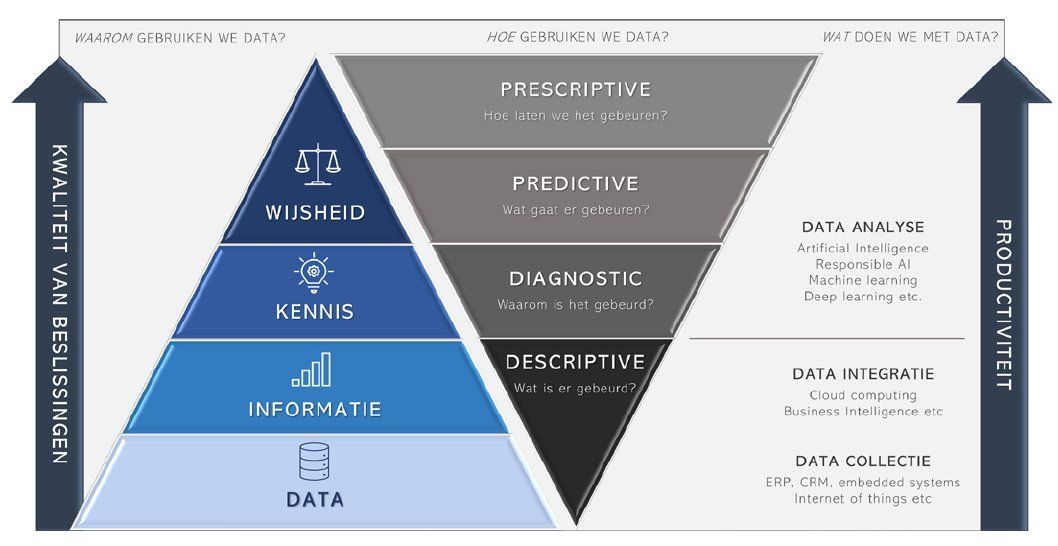

De tekst van Eliot is volgens velen de basis van het in ICT-land bekende DIKW-model. Het model geeft antwoord op de vraag waarom we data en informatie in willen zetten, namelijk zodat de mens betere beslissingen kan nemen. We onderscheiden vier niveaus:

• Het eerste niveau is data . Dat zijn simpele facts & figures. Het is de enorme berg big data, zoals bijvoorbeeld alle opgeslagen polismutaties. Zonder analyse kunnen we hier niets mee.

• Het tweede niveau is informatie . Informatie is alle data die is gebundeld, georganiseerd en het liefst gevisualiseerd. Dit zodat we kunnen zeggen wat er is gebeurd en bijvoorbeeld te gebruiken als benchmark. Hoeveel polissen zijn er geroyeerd in 2022 ten opzichte van 2021?

• Het derde niveau omvat kennis . Dit is informatie waaruit, gegeven de context, onderliggende patronen te herleiden zijn. Hiermee beantwoord je de vraag waarom iets is gebeurd. Waarom royeerden klanten hun polis? Waarom waren ze ontevreden? Premieverhoging? Slechte schadeafwikkeling?

• Het laatste niveau gaat over wijsheid . Idealiter gebruiken we de vergaarde kennis om nu en in de toekomst betere beslissingen te nemen die in ieders belang zijn. Wellicht kunnen we op basis van patronen uit het verleden voorspellen wie een polis gaat opzeggen? En belangrijker: kunnen we voorspellen hoe we kunnen voorkomen dat een klant ontevreden wordt?

De vier niveaus uit het DIKW-model correleren met de vier levels van datavolwassenheid waarin een organisatie zich kan bevinden te weten: descriptive level (data ordenen tot informatie); diagnostic level (kennis vergaren door uit informatie patronen te halen); predictive level (kennis gebruiken om te voorspellen wat er gaat gebeuren) en prescriptive level (voorschrijven hoe we het laten gebeuren of voorkomen). Datavolwassenheid geeft aan in hoeverre een bedrijf zijn databronnen effectief inzet om daarmee productiviteit te verhogen. Op de hoogste niveaus ontkom je niet aan de inzet van artificial intelligence (AI) technologie. Als we streven naar wijsheid, willen we deze technologie op de juiste manier inzetten en daarin speelt ethiek een belangrijke rol.

Jack Vos: ‘Streven naar wijsheid.’

AI voor adviseurs

Veel verzekeraars, volmachten en intermediairs worstelen met de vraag hoe ze tienduizenden klanten optimaal kunnen blijven bedienen. Dit kan alleen maar schaalbaar door het slim inzetten van data en AI-technologie, want meer adviseurs inzetten, dat is simpelweg te duur. AI maakt gebruik van zelflerende algoritmes – in feite wiskundige formules - die in staat zijn miljoenen datapunten te analyseren op correlaties. Hieruit worden met complexe software voorspellende patronen gehaald die aangeven of iets goed werkt of juist niet. Zo kan bijvoorbeeld per klant een onderbouwde voorspelling gedaan worden welke acties in de customer journey leiden tot de hoogste klanttevredenheid met ook nog eens het hoogste rendement voor het kantoor. Deze kennis stelt adviseurs in staat om doeltreffender te werk te gaan en hun kostbare tijd zo effectief mogelijk te besteden.

Er zijn mensen die AI-technologie wantrouwen, omdat het naar hun mening opereert in een ‘black box’. Dit betekent dat wel de ingaande en uitgaande informatiestromen van het algoritme te zien zijn, maar niet de mechanismes die deze twee stromen aan elkaar verbinden. Vanuit de ambitie te streven naar wijsheid, willen we juist de eigenschappen van deze mechanismes weten om de interpreteerbaarheid van AI te waarborgen. Dit is cruciaal als er met persoonlijke data gewerkt wordt.

Max Roeters: ‘De mens in de loop houden.’

Responsible AI

De gedachte achter de methodologie die responsible AI wordt genoemd, is om het algoritme vanaf scratch zo te ontwikkelen en in te richten dat de gebruiker te allen tijde een weloverwogen beslissing kan nemen of het inzetten ervan ethisch verantwoord is gegeven de context. Het ethisch kader data gedreven besluitvorming , opgesteld door het Verbond van Verzekeraars, sluit hier goed bij aan. Dit kader bepaalt dat er bij het ethisch gebruik van AI zeven vereisten in acht moeten worden genomen. De precieze normen kun je vinden in het ethisch kader, hieronder een korte toelichting:

1. Menselijke autonomie & controle

AI moet een middel zijn om tot een bepaalde oplossing te komen, niet het doel zelf. Dit betekent dat als er minder ingewikkelde technologie gebruikt kan worden om tot hetzelfde resultaat te komen, dit de voorkeur geniet. Er dient tevens genoeg aandacht besteed te worden aan risico’s en mogelijke tegengestelde belangen.

2. Technische robuustheid en veiligheid

Logischerwijs moeten klantgegevens beschermd worden en is het verstandig de kwaliteit van de data te (blijven) waarborgen. Klantgegevens die niet meer upto-date zijn, kunnen immers onbedoeld leiden tot foutieve inzichten.

3. Privacy en data governance

Bij het werken met data, is het waarborgen van privacy enorm belangrijk. Menselijk toezicht is cruciaal, want je kunt niet voorkomen dat er bepaalde vooroordelen ( bias ) in het model terechtkomen. Door hier aandachtig en preventief mee aan de slag te gaan, voorkom je onnodige fouten.

4. Transparantie

Zeker wanneer er beslissingen genomen worden die een significante impact kunnen hebben op het leven van een persoon - denk bijvoorbeeld aan afwijzing van een uitkering - is het van belang om het AI-model zodanig in te richten dat het altijd mogelijk is om klanten uitleg te kunnen geven over hoe een beslissing tot stand is gekomen.

5. Diversiteit, non-discriminatie en rechtvaardigheid

Het is belangrijk te erkennen dat net als de mens zelf, het haast onmogelijk is om tot een geheel bias-free AImodel te komen. Door extra aandacht te geven aan onder-gerepresenteerde of kwetsbare groepen, voorkom je dat het model hierop - al dan niet onbewust - gaat discrimineren.

6. Maatschappelijk welzijn

Ook met AI moeten zoveel mogelijk klanten verzekerbaar blijven en zij die moeilijker of onverzekerbaar dreigen te worden, moeten geïnformeerd worden over manieren om risico’s te verlagen of af te dekken. Juist door modellen interpreteerbaar en transparant in te richten, kunnen klanten nog gerichter geïnformeerd worden, bijvoorbeeld door aan te geven op basis van welke klanteigenschappen de beslissing is gebaseerd.

7. Verantwoording

Een veilige en ontvankelijke interactie over de mogelijke risico’s van AI, tussen verzekeraar, haar medewerkers en haar klanten is essentieel. Daarom dient al tijdens de ontwikkeling aandacht besteed te worden aan mechanismen die men in staat stelt de technologie te blijven beoordelen.

De human in de loop

Wat een mens niet kan, kan AI-technologie wel: enorme hoeveelheden data omzetten tot bruikbare informatie en hierin voorspellende patronen herkennen. Daardoor zijn verzekeringsbedrijven in staat adviseurs effectiever in te zetten, zeker als ze tien- of soms wel honderdduizenden klanten schaalbaar willen bedienen. Bij het streven naar wijsheid willen we wel de human in de loop houden. Het ethisch kader biedt handvaten die de kwaliteit van een AI-model helpen waarborgen. Dit is geen bedreiging voor AI, juist hierdoor zal AI veel eerder gebruikt en geaccepteerd worden, zeker als de methode van responsible AI wordt gebruikt. De adviseur houdt altijd een belangrijke rol, zolang hij op het juiste moment intermenselijke kwaliteiten zoals empathie, vriendelijkheid en vertrouwen inbrengt.

Reactie toevoegen

Meer over

Hoe operationaliseer je een getraind algoritme?

(Dennie van den Biggelaar, Onesurance, in Ken je vak! VVP 2-2024) In dit tweede deel van de serie AI in de Adviespraktijk beantwoorden we de vraag: hoe operationaliseer...

Spotters dragen 180 topkantoren aan voor longlist VVP Advies Award

Naar aanleiding van de spottersbijeenkomst van 10 april 2024 van juryleden en spotters van de VVP Advies Award 2024 heeft de jury drie kantoren per categorie in...

Bepaal zelf uw toekomst en word local hero of global player

(Jack Vos, Onesurance en lid VVP Ondernemerspanel, in VVP 1-2024) Intermediairs waren ooit gefragmenteerd en nationaal georiënteerd, maar dit verschuift nu...

Maar liefst 38 spotters op zoek naar excellente advieskantoren voor de VVP Advies Award 2024

Maar liefst 38 spotters (experts in de haarvaten van de financiële advieswereld) zijn voor de zesde editie van de VVP Advies Award op zoek naar de meest excellente...

Starten met specifieke AI en ML

(Dennie van den Biggelaar, Onesurance, in Ken je vak! in VVP 1-2024) We starten in deze eerste editie van AI in de Adviespraktijk bij het begin: wat is het en...

DAS gastheer spottersbijeenkomst Advies Award 2024

DAS is op woensdag 10 april gastheer van de spottersbijeenkomst van de VVP Advies Awards 2024. De spotters - experts is de haarvaten van het financiële adviesvak...

Onesurance en Insurance Data lanceren AI Engine

Insurance Data en Onesurance gaan samenwerken om het gebruik van data in de verzekeringsmarkt te verbeteren. Hiertoe is door Onesurance een geavanceerde AI Engine...

Nieuwe juryvoorzitter en -leden VVP Advies Award

Odette Bakker (Dazure) is de nieuwe juryvoorzitter van de VVP Advies Award. Zij neemt het stokje over van Richard Meinders (SVC Groep), die net als jurylid Bob Klijn...

(Jack Vos, Onesurance en lid VVP Ondernemerspanel, in VVP 6-2023) Kiest u in het consolidatiegeweld voor samenwerken of specialiseren? Welke keuze u ook maakt,...

Hoe voorkom je KIESpijn bij strategische keuzes?

(Jack Vos, Onesurance, in VVP 5-2023) De wereld om ons heen verandert zo snel dat traditionele verzekeringswereld voor enkele cruciale dilemma’s staat die...